Az Nvidia NeMo Guardrails: A szöveggeneráló AI biztonságosabbá tétele

Az Nvidia legújabb nyílt forráskódú eszközkészlete, a NeMo Guardrails célja, hogy javítsa az AI-val működő alkalmazások pontosságát, megfelelőségét, aktualitását és biztonságát.

Az OpenAI GPT-4-hez hasonló szöveggeneráló AI-modelleket övező népszerűség és a hype ellenére ezek a modellek hajlamosak az elfogultságra, a toxicitásra és a rosszindulatú támadásokra. Az Nvidia a "biztonságosabb" szöveggeneráló modellek kifejlesztésére törekedve kiadta a NeMo Guardrails-t, egy nyílt forráskódú eszközkészletet, amely növeli az AI-alapú alkalmazások biztonságát.

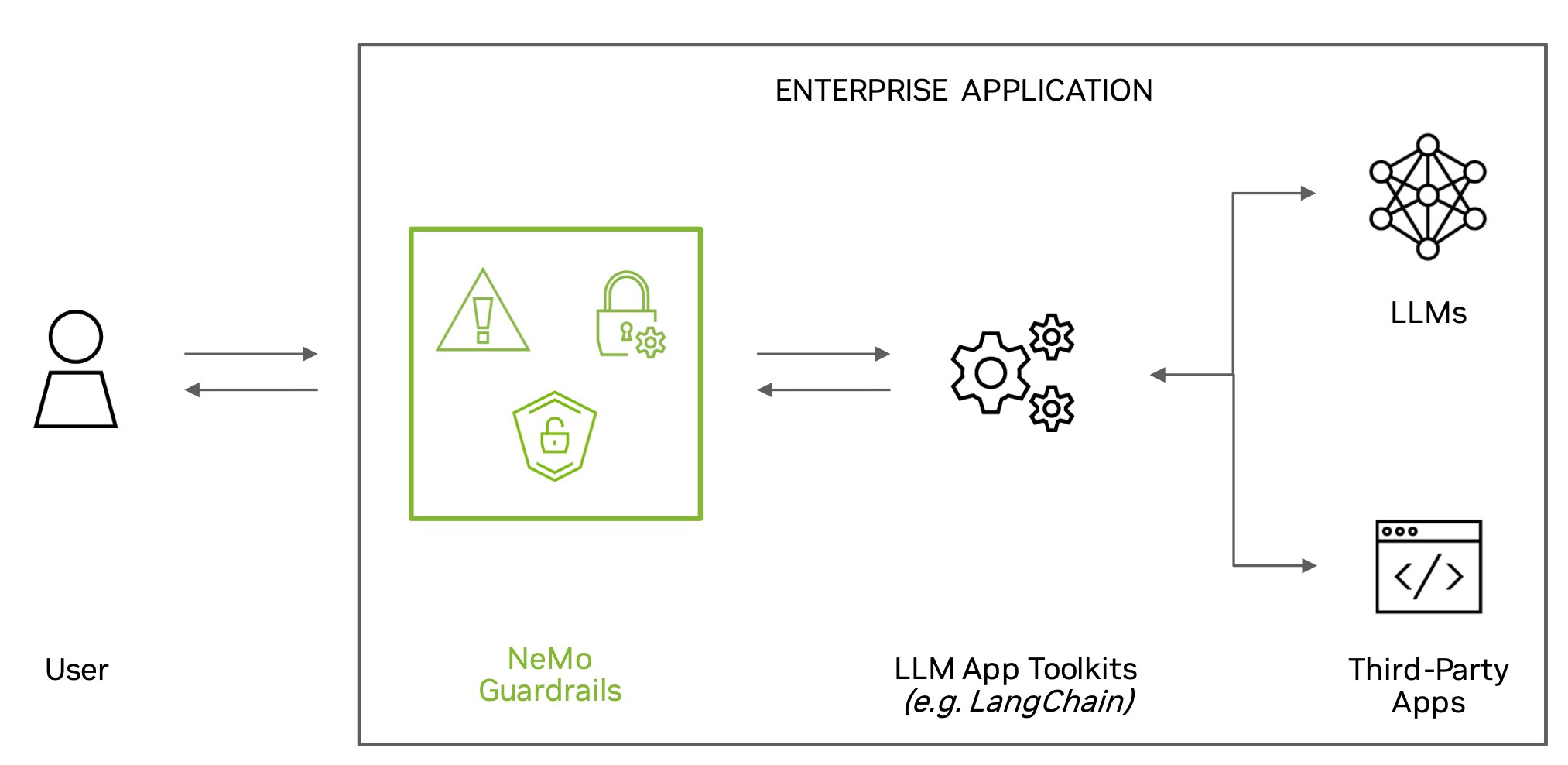

A NeMo Guardrails a legtöbb generatív nyelvi modellel való együttműködésre készült, lehetővé téve a fejlesztők számára, hogy néhány sornyi kóddal szabályokat hozzanak létre. Az eszközkészlet kódot, példákat és dokumentációt tartalmaz, hogy "biztonságot adjon" a szöveget és beszédet is generáló AI-alkalmazásoknak. Segítségével megakadályozható, hogy a modellek eltérjenek a témától, pontatlan információkkal vagy mérgező nyelvezettel válaszoljanak, és "nem biztonságos" külső forrásokkal létesítsenek kapcsolatot.

Bár a Guardrails nem jelent univerzális megoldást a nyelvi modellek hiányosságaira, a generatív modellek biztonságát növelheti. Az Nvidia elismeri, hogy az eszközkészletnek vannak korlátai, és nem fog mindent megoldani, de ez egy lépés a biztonságosabb AI-alapú alkalmazások felé.

Az Nvidia alkalmazott kutatásért felelős alelnöke, Jonathan Cohen szerint a vállalat évek óta dolgozik a Guardrails alaprendszerén és egy évvel ezelőtt jöttek rá, hogy az olyan modellekhez, mint a GPT-4 és a ChatGPT, jól illeszkedik. Cohen szerint a mesterséges intelligencia modell biztonsági eszközei kritikus fontosságúak a vállalati felhasználási esetekre vonatkozó modellek bevezetésében.

A Guardrails azonban olyan modellekkel működik a legjobban, amelyek "kellően jók az utasításkövetésben", mint például a ChatGPT és az AI-alapú alkalmazások építésére szolgáló népszerű LangChain keretrendszert használó modellek. Az Nvidia elismeri, hogy egyes nyílt forráskódú lehetőségek nem feltétlenül kompatibilisek a Guardrails-szel.

A Guardrails az Nvidia NeMo keretrendszerének része, amely a vállalati AI-szoftvercsomagján és a NeMo teljesen menedzselt felhőszolgáltatásán keresztül érhető el. Bármely cég megvalósíthatja a Guardrails nyílt forráskódú kiadását, de az Nvidia jobban szeretné, ha a hosztolt verzióért fizetnének.

Összefoglalva, bár a Guardrails nem egy csodafegyver, de egy lépés a biztonságosabb AI-alapú alkalmazások fejlesztése felé. A fejlesztők felelőssége, hogy felállítsák az alkalmazásaikra vonatkozó szabályokat, és előfordulhat, hogy olyan Guardrails-t fejlesztenek ki, amely túl széles vagy túl szűk a felhasználási esetükhöz.

- Legfrissebb

- Nem a technológia hiányzik, hanem a szokás: az Eurostat szerint az európaiak többsége nem érzi szükségesnek az AI-eszközöket

- A Google törölte a Disney-szereplős AI-videókat a YouTube-ról, miután felszólító levelet kapott

- Codex Mortis: ez a videójáték már teljes egészében mesterséges intelligenciával készült, ki is próbálhatod

- GPT-5.2 bemutató: az OpenAI új csúcsmodellje már nem csak válaszol, hanem munkatársként működik

- Hogyan növekednek gyorsabban a vállalkozások az AI-alapú digitális marketingplatformokkal?

- Meglepő igazság: több milliárdos interakció elemzéséből derült ki, hogyan is használjuk a mesterséges intelligenciát

- Az AI-tagadás mint vállalati kockázat: tényleg csak digitális moslékot csinál a mesterséges intelligencia?

- Ez lesz az OpenAI új gyónási rendszere: amikor a modell maga vallja be, ha hibázott

- A chatbotok sokkal hatékonyabban formálják a politikai véleményt, mint a tévés kampányhirdetések

- Áttörés a mellrákszűrésben? A DeepHealth új platformja már most átírja a radiológia jövőjét

- Képernyőidő

- Most az urológus TikTokon válaszol azokra a kérdésekre, amelyeket nem mertünk megkérdezni tőle a rendelőben

- Az adóbevallásnál válnak csak igazán veszélyessé a NAV-os csalások, egyetlen kattintás is elég lehet a bajhoz

- Ingyen játék: három ajándékot is megszerezhetsz most Steamen, de alig pár órád van rá

- A chatbot nem csak tévedhet, hanem minket is egyre jobban befolyásolhat

- Újabb jelentés bizonyítja, hogy a közösségi média tiltása populista illúzió

- Legnépszerűbb címkék

- OpenAI

- ChatGPT

- generatív AI

- AI

- Microsoft

- innováció

- NVIDIA

- GPT-4

- technológia