Az EU AI-törvénye és annak hatása a vállalkozások AI-szabályozására

Miközben az Európai Unió véglegesíti a mesterséges intelligenciáról szóló törvényt, a vállalkozásoknak fel kell készülniük a szigorúbb AI-szabályozásokra, és többek közt felelős AI-kereteket kell elfogadniuk.

Az Egyesült Államokban a vállalkozások még nem voltak tanúi az AI-tervezést irányító egyértelmű szabályozásoknak vagy törvényeknek, ellentétben más iparágakkal, mint például az élelmiszeripar, az orvostudomány és az autóipar. Szabványos irányelvek nélkül a vállalkozások a saját felfogásuk szerint dolgoztak a helyes és helytelen alapján. Ez azonban hamarosan megváltozik, és a mesterséges intelligenciát érintő szabályozási környezet az általános, javasolt keretekről az állandóbb törvények felé fog elmozdulni, ahogy a generatív mesterséges intelligencia továbbra is gyorsan fejlődik.

Az uniós AI-törvény jelentős beszélgetéseket indított el az üzleti vezetők körében, különösen az Egyesült Államokban, arról, hogyan készüljenek fel a szigorúbb AI-szabályozásra. Az uniós AI-törvény várhatóan az AI-szabályozás globális szabványává válik, hasonlóan a 2018-ban kiadott EU Általános Adatvédelmi Rendelethez (GDPR). Az AI-törvény tervezetéről 2023. március végéig kell szavazni, a végleges AI-törvényt pedig az év végére fogadhatják el.

Az AI-törvény hatásai várhatóan az EU határain túl is érezhetőek lesznek, mivel a nemzetközi szinten működő szervezeteknek meg kell majd felelniük a jogszabályoknak. Ilyen például Kanada mesterséges intelligenciáról és adatokról szóló törvényjavaslata és New York City automatizált foglalkoztatásra vonatkozó szabályozása.

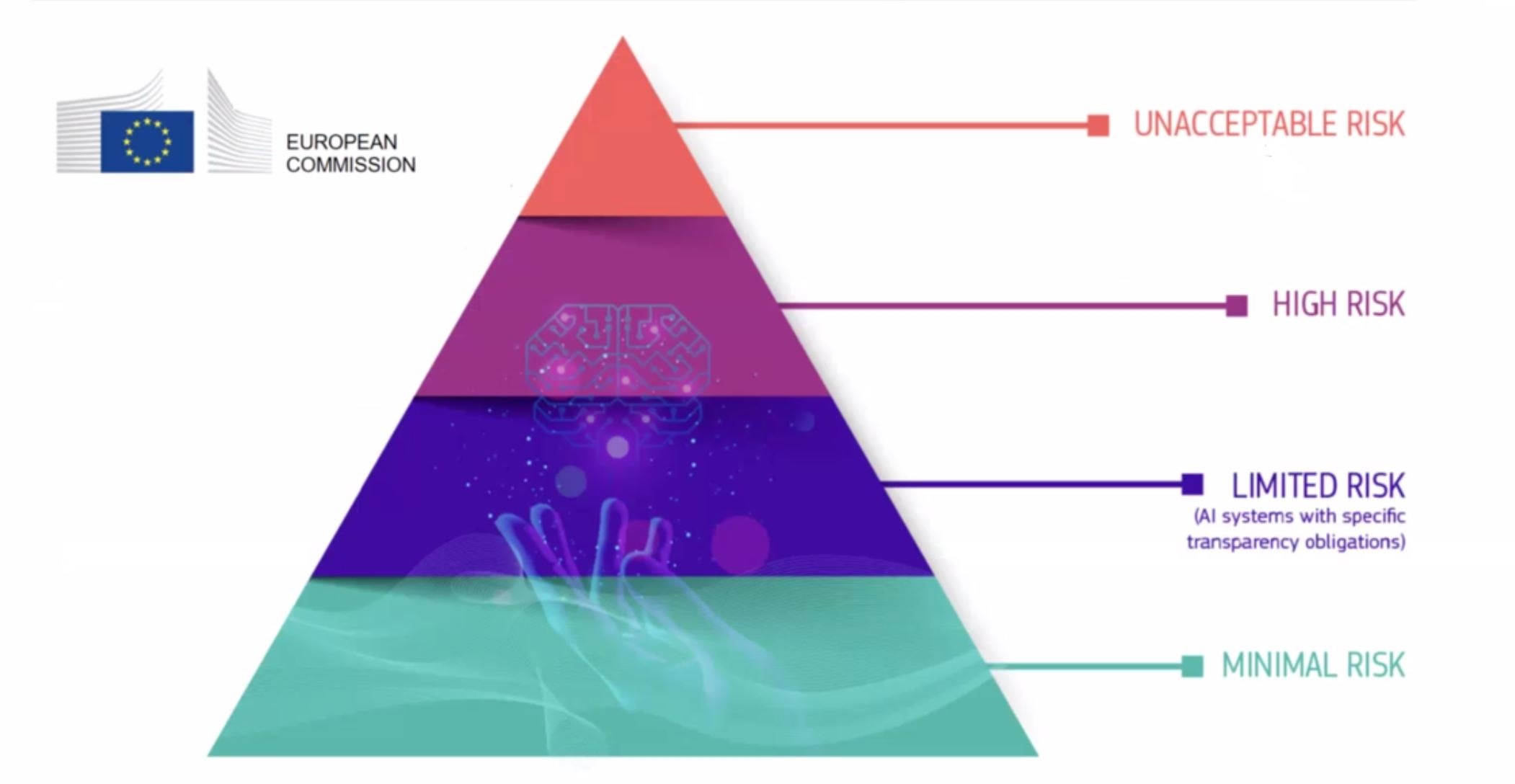

A mesterséges intelligencia törvény értelmében a szervezetek AI-rendszereit három kockázati kategóriába sorolják majd, és minden egyes kategóriának megvannak a maga iránymutatásai és következményei. Az elfogadhatatlan kockázati kategóriába tartoznak a manipulatív, kárt okozó rendszerek, a közterületeken a bűnüldözésben használt valós idejű biometrikus azonosító rendszerek és a társadalmi pontozás minden formája. A magas kockázatú rendszerek közé tartoznak az olyan eszközök, mint például az álláspályázók vizsgálati modelljei, és külön jogi követelmények vonatkoznak rájuk. A korlátozott és minimális kockázatú rendszerek közé tartozik számos, a vállalkozások által ma használt mesterséges intelligencia alkalmazás, például a chatbotok és a mesterséges intelligenciával működő leltárkezelő eszközök, és nagyrészt szabályozatlanok maradnak. A korlátozott kockázatú, az ügyfeleknek szánt alkalmazások esetében közzé kell majd tenni, hogy mesterséges intelligenciát alkalmaznak.

Bár a mesterséges intelligenciáról szóló törvény még csak kidolgozás alatt áll és globális hatásait még nem határozták meg, a szabályozás valószínűleg iparágtól, a tervezett modell típusától és a kockázati kategóriától függően változik majd. A magas kockázatú AI-rendszerekkel rendelkező szervezeteknek kockázatkezelési rendszert, adatirányítást és -kezelést, műszaki dokumentációt, nyilvántartást és naplózást, átláthatóságot és a felhasználók tájékoztatását, emberi felügyeletet, pontosságot, robusztusságot, kiberbiztonságot, megfelelőségértékelést, az EU-tagállam kormányánál történő regisztrációt és forgalomba hozatal utáni felügyeleti rendszert kell majd bevezetniük.

A modellek megbízhatósági tesztelése egyre szélesebb körben elterjedtebb szolgáltatássá válik a mesterséges intelligencia iparban. A gépjárművek ellenőrzéséhez hasonlóan a rendszeres megbízhatósági tesztelés során a modelleket a kiszolgálni kívánt népességhez viszonyítva tesztelik, olyan kérdéseket értékelve, mint például: "Elfogadható hibahatáron belül teljesít-e a modell?" és "Nyilvánosságra hozza-e a modell jellegét és használatát?".

A vállalkozások felkészülhetnek a szigorúbb AI-szabályozásra azáltal, hogy kutatják és oktatják csapataikat a létező szabályozás típusairól, valamint arról, hogy az hogyan befolyásolja a vállalatot ma és a jövőben. Ellenőrizhetik a meglévő és tervezett modelleket, hogy meghatározzák, melyik kockázati kategóriához igazodnak, és mely kapcsolódó szabályozások lesznek rájuk a legnagyobb hatással. A vállalkozásoknak emellett ki kell dolgozniuk és el kell fogadniuk a felelős AI-megoldások tervezésének keretrendszerét, át kell gondolniuk a mesterséges intelligencia kockázatcsökkentési stratégiájukat, és létre kell hozniuk egy AI-irányítási és jelentéstételi stratégiát, amely biztosítja a többszörös ellenőrzést, mielőtt egy modell éles üzembe áll.

- Legfrissebb

- Nem a technológia hiányzik, hanem a szokás: az Eurostat szerint az európaiak többsége nem érzi szükségesnek az AI-eszközöket

- A Google törölte a Disney-szereplős AI-videókat a YouTube-ról, miután felszólító levelet kapott

- Codex Mortis: ez a videójáték már teljes egészében mesterséges intelligenciával készült, ki is próbálhatod

- GPT-5.2 bemutató: az OpenAI új csúcsmodellje már nem csak válaszol, hanem munkatársként működik

- Hogyan növekednek gyorsabban a vállalkozások az AI-alapú digitális marketingplatformokkal?

- Meglepő igazság: több milliárdos interakció elemzéséből derült ki, hogyan is használjuk a mesterséges intelligenciát

- Az AI-tagadás mint vállalati kockázat: tényleg csak digitális moslékot csinál a mesterséges intelligencia?

- Ez lesz az OpenAI új gyónási rendszere: amikor a modell maga vallja be, ha hibázott

- A chatbotok sokkal hatékonyabban formálják a politikai véleményt, mint a tévés kampányhirdetések

- Áttörés a mellrákszűrésben? A DeepHealth új platformja már most átírja a radiológia jövőjét

- Képernyőidő

- Már nem csak „játszik a gyerek” - díjazták a magyar e-sport legjobbjait

- Ingyen játék: Batman legsötétebb oldala és egy közös családi kaland jár most ajándékba az Epicnél

- 10 másodperc elég ahhoz, hogy ne induljon el a végtelen görgetés telefonon?

- A Holdon játszódik, mégis egy apa legfájóbb emlékét hozta vissza a Pragmata

- Most az urológus TikTokon válaszol azokra a kérdésekre, amelyeket nem mertünk megkérdezni tőle a rendelőben

- Legnépszerűbb címkék

- OpenAI

- ChatGPT

- generatív AI

- AI

- Microsoft

- innováció

- NVIDIA

- GPT-4

- technológia