Az OpenAI társalapítója a ChatGPT-hez hasonló AI-modellekkel való lehetséges károkozásra figyelmeztet

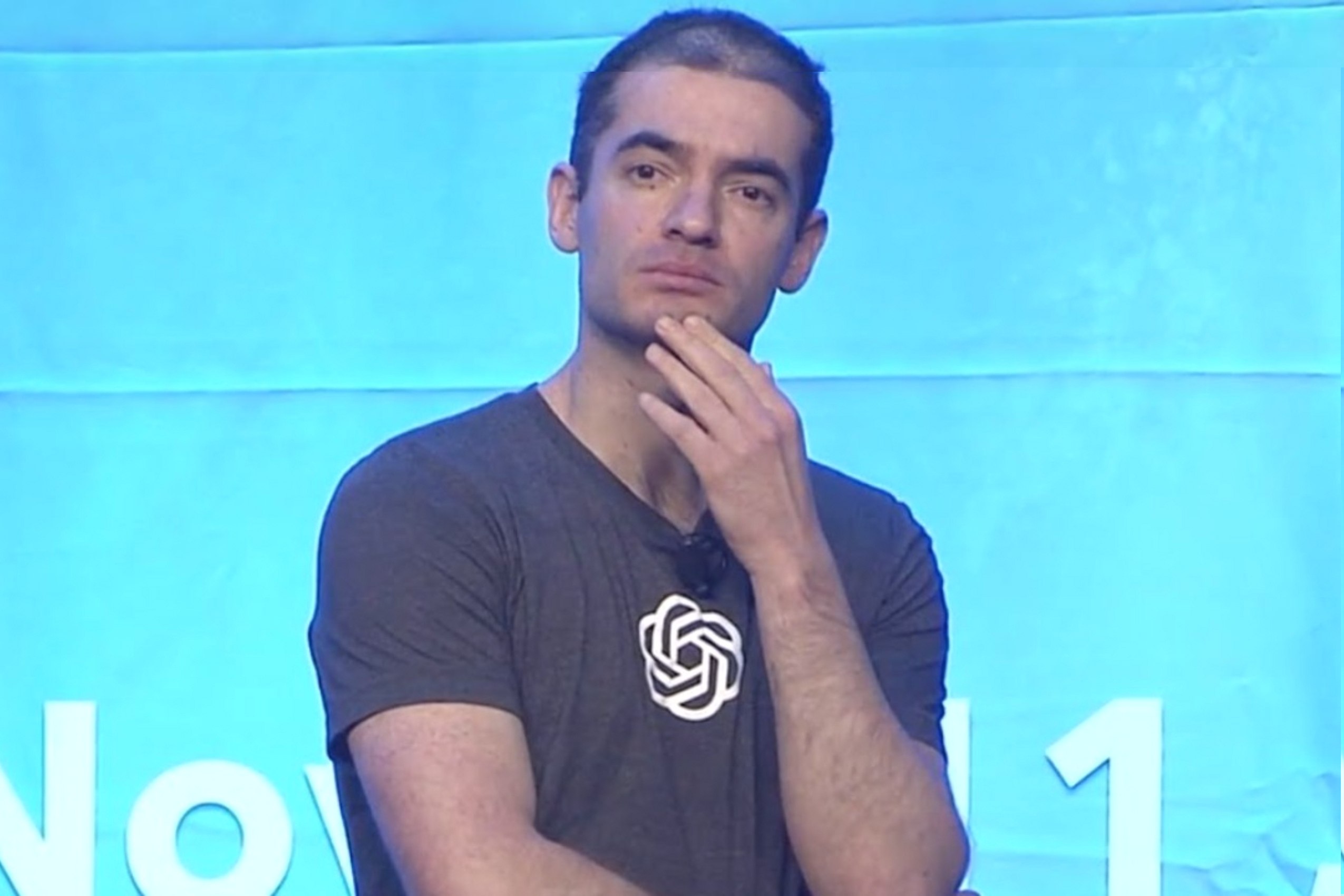

Az OpenAI társalapítója, Ilya Sutskever aggodalmát fejezte ki a ChatGPT-hez hasonló AI chatrobotok lehetséges visszaélése miatt, kijelentve, hogy egy bizonyos ponton könnyen nagy kárt lehet okozni velük.

Az OpenAI által nemrégiben kiadott ChatGPT aggodalmakat váltott ki az AI chatbotok lehetséges visszaéléseivel kapcsolatban, és a szakértők arra figyelmeztetnek, hogy könnyen ki lehet őket használni arra, hogy kárt okozzanak. Ilya Sutskever, az OpenAI vezető tudósa és társalapítója kifejtette, hogy a ChatGPT-hez hasonló AI-modellek egyre erősebbek, és eljön majd az idő, amikor jelentős károkozásra lehet használni őket. "Egy bizonyos ponton elég könnyű lesz, ha valaki akarja, nagy kárt okozhat ezekkel a modellekkel" - mondta.

Ilya Sutskever azt is elárulta, hogy az OpenAI már nem ad részletes tájékoztatást arról, hogyan képzi ki ezeket az AI-modelleket a növekvő képességeivel kapcsolatos aggodalmak miatt. Kijelentette, hogy ahogy ezeknek a modelleknek a képességei növekednek, úgy van értelme nem nyilvánosságra hozni azokat, hozzátéve, hogy "a mesterséges inteligencia nyílt kiszervezése egyszerűen nem bölcs dolog".

Az OpenAI vezérigazgatója, Sam Altman is hasonló aggodalmaknak adott hangot az AI-modellek esetleges kártékonyságával kapcsolatban. Bár elismerte, hogy a mesterséges intelligencia "hihetetlenül jó" lehet, arra is figyelmeztetett, hogy a legrosszabb esetben "mindannyiunk számára kialszik a fény". Altman már korábban kijelentette, hogy az AI-eszközök szabályozása kritikus fontosságú lesz, mivel a világ talán már nincs is olyan messze a potenciálisan ijesztő mesterséges intelligencia eszközöktől.

- Legfrissebb

- Nem a technológia hiányzik, hanem a szokás: az Eurostat szerint az európaiak többsége nem érzi szükségesnek az AI-eszközöket

- A Google törölte a Disney-szereplős AI-videókat a YouTube-ról, miután felszólító levelet kapott

- Codex Mortis: ez a videójáték már teljes egészében mesterséges intelligenciával készült, ki is próbálhatod

- GPT-5.2 bemutató: az OpenAI új csúcsmodellje már nem csak válaszol, hanem munkatársként működik

- Hogyan növekednek gyorsabban a vállalkozások az AI-alapú digitális marketingplatformokkal?

- Meglepő igazság: több milliárdos interakció elemzéséből derült ki, hogyan is használjuk a mesterséges intelligenciát

- Az AI-tagadás mint vállalati kockázat: tényleg csak digitális moslékot csinál a mesterséges intelligencia?

- Ez lesz az OpenAI új gyónási rendszere: amikor a modell maga vallja be, ha hibázott

- A chatbotok sokkal hatékonyabban formálják a politikai véleményt, mint a tévés kampányhirdetések

- Áttörés a mellrákszűrésben? A DeepHealth új platformja már most átírja a radiológia jövőjét

- Képernyőidő

- A Holdon játszódik, mégis egy apa legfájóbb emlékét hozta vissza a Pragmata

- Most az urológus TikTokon válaszol azokra a kérdésekre, amelyeket nem mertünk megkérdezni tőle a rendelőben

- Az adóbevallásnál válnak csak igazán veszélyessé a NAV-os csalások, egyetlen kattintás is elég lehet a bajhoz

- Ingyen játék: három ajándékot is megszerezhetsz most Steamen, de alig pár órád van rá

- A chatbot nem csak tévedhet, hanem minket is egyre jobban befolyásolhat

- Legnépszerűbb címkék

- OpenAI

- ChatGPT

- generatív AI

- AI

- Microsoft

- innováció

- NVIDIA

- GPT-4

- technológia