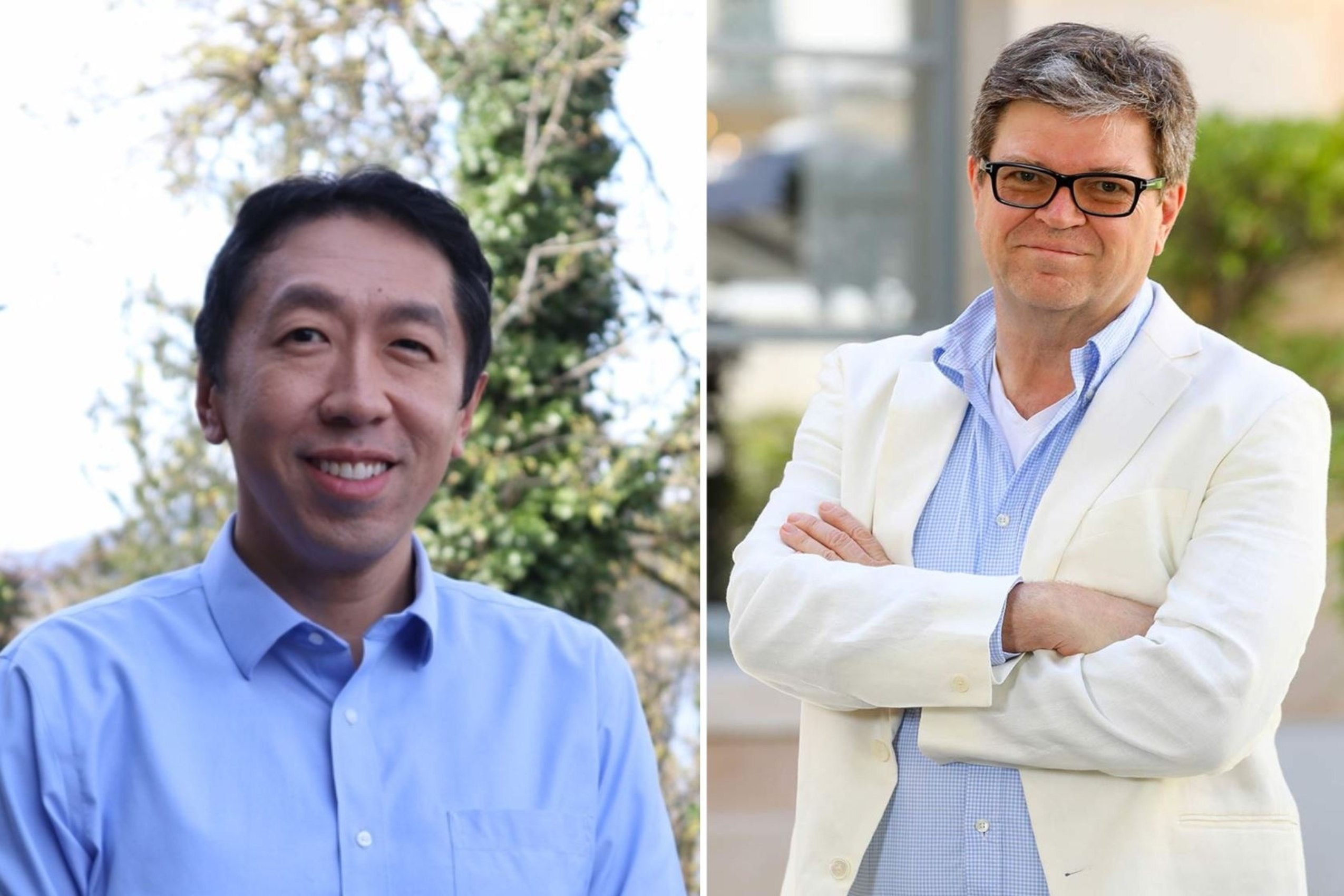

Andrew Ng és Yann LeCun, az AI titánjai ellenzik az AI fejlesztésére javasolt szünetet

A mesterséges intelligencia ipar két vezető személyisége, Andrew Ng és Yann LeCun felszólalt a fejlett AI-rendszerek fejlesztésének javasolt szüneteltetése ellen.

Andrew Ng, a Deeplearning.AI alapítója és Yann LeCun, a Meta vezető mesterséges intelligencia kutatója egy pénteki online vitában a nagy teljesítményű mesterséges intelligencia rendszerek fejlesztésére javasolt szünet ellen érvelt. A YouTube-on megrendezett vitát több ezren látták, és a "Miért rossz ötlet a 6 hónapos AI-szünet" címet viselte. A vita során LeCun és Ng megkérdőjelezte a múlt hónapban több száz mesterséges intelligencia szakértő, technológiai vállalkozó és tudós által aláírt nyílt levelet, amelyben legalább hat hónapos moratóriumot követeltek a GPT-4-nél fejlettebb AI-rendszerek képzésére, egy olyan szöveggeneráló programra, amely szinte bármilyen kérdésre vagy témára képes valósághű és összefüggő válaszokat adni.

Andrew Ng azzal kezdte, hogy ismertette a mesterséges intelligencia terén különösen az elmúlt néhány évben elért figyelemre méltó fejlődést, amelyet a mély tanulási technikák tettek lehetővé, és amelynek köszönhetően olyan generatív AI-rendszerek jöttek létre, mint a ChatGPT, az LLaMa, a Midjourney, a Stable Diffusion és a Dall-E, amelyek képesek valósághű szövegek, képek és hangok előállítására. Ezek a rendszerek új alkalmazásokhoz és lehetőségekhez fűzött reményeket, valamint aggodalmakat ébresztettek a lehetséges ártalmakkal és kockázatokkal kapcsolatban.

Yann LeCun hozzátette, hogy az aggodalmak egy része a jelenhez és a közeljövőhöz kapcsolódik, mint például a méltányosság, az elfogultság és a társadalmi-gazdasági kiszorulás, míg mások inkább spekulatívak és távoliak, mint például a mesterséges általános intelligencia (AGI) megjelenése és annak lehetséges rosszindulatú vagy nem szándékolt következményei. Bár LeCun egyetértett azzal, hogy vannak valós potenciális károk és veszélyek, amelyekkel foglalkozni kell, bírálta a képzelőerő hiányát abban az értelemben, hogy a jövőbeli AI-rendszereket nem ugyanolyan tervezet alapján építikik majd, mint a jelenlegi fejlődésben visszafelé haladó LLM-eket, mint a ChatGPT és a GPT-4, vagy az előttük lévő más rendszereket, mint a Galactica vagy a Bard. LeCun úgy véli, hogy lesznek olyan új ötletek, amelyek sokkal jobban irányíthatóvá teszik majd ezeket a rendszereket.

Az online eseményre egy növekvő vita közepette került sor, amely arról szólt, hogyan szabályozzák az új LLM-eket, amelyek szinte bármilyen témában képesek valósághű szövegeket előállítani. Ezek a mély tanuláson alapuló és hatalmas mennyiségű online adaton betanított modellek aggodalmat keltettek a visszaélések és károkozás lehetőségével kapcsolatban. A vita három héttel ezelőtt eszkalálódott, amikor az OpenAI kiadta a GPT-4-et, a legújabb és legerősebb modelljét.

Andrew Ng és Yann LeCun egyetértett abban, hogy szükség van némi szabályozásra, de nem a kutatás és az innováció rovására. Azzal érveltek, hogy e modellek fejlesztésének vagy alkalmazásának szüneteltetése irreális és kontraproduktív. Emellett több együttműködést és átláthatóságot sürgetnek a kutatók, a kormányok és a vállalatok között, hogy biztosítsák e modellek etikus és felelős használatát.

Yann LeCun hangsúlyozta, hogy a kutatás és fejlesztés késleltetésére való felhívás az elhomályosodás új hulláma, és hogy ez lelassítja a tudás és a tudomány fejlődését. Nem látja más értelmét a kutatás és fejlesztés szabályozásának, mint hogy csökkentse azt a tudást, amelyet a technológia jobbá és biztonságosabbá tételére használhatnánk. Ng ezzel szemben úgy véli, hogy bár a mesterséges intelligenciának vannak ártalmi kockázatai, például az elfogultság, a méltányosság és a hatalom koncentrációja, ugyanakkor óriási értéket is teremt. Szerinte a GPT-4-nél is jobb AI-rendszerek megalkotása minden alkalmazásnak és embernek segíteni fog.

- Legfrissebb

- Nem a technológia hiányzik, hanem a szokás: az Eurostat szerint az európaiak többsége nem érzi szükségesnek az AI-eszközöket

- A Google törölte a Disney-szereplős AI-videókat a YouTube-ról, miután felszólító levelet kapott

- Codex Mortis: ez a videójáték már teljes egészében mesterséges intelligenciával készült, ki is próbálhatod

- GPT-5.2 bemutató: az OpenAI új csúcsmodellje már nem csak válaszol, hanem munkatársként működik

- Hogyan növekednek gyorsabban a vállalkozások az AI-alapú digitális marketingplatformokkal?

- Meglepő igazság: több milliárdos interakció elemzéséből derült ki, hogyan is használjuk a mesterséges intelligenciát

- Az AI-tagadás mint vállalati kockázat: tényleg csak digitális moslékot csinál a mesterséges intelligencia?

- Ez lesz az OpenAI új gyónási rendszere: amikor a modell maga vallja be, ha hibázott

- A chatbotok sokkal hatékonyabban formálják a politikai véleményt, mint a tévés kampányhirdetések

- Áttörés a mellrákszűrésben? A DeepHealth új platformja már most átírja a radiológia jövőjét

- Képernyőidő

- Vampire Crawlers teszt szülőknek

- Miért csak a gyerek képernyőidejéről beszélgetünk, amikor az egészséges családi működésről van szó?

- A bocsánatkérést akarod megtanítani a gyereknek? Így segíthet a Bluey benne

- Nem minden fekete-fehér: mit gondolnak valójában a tinédzserek a közösségi médiáról?

- 2027-től házilag cserélhető akkut írnak elő a telefonokban, de a gyártók nagy része ezt megúszhatja

- Legnépszerűbb címkék

- OpenAI

- ChatGPT

- generatív AI

- AI

- Microsoft

- innováció

- NVIDIA

- GPT-4

- technológia